L'IA divise-t-elle le marché du travail en deux classes ?

La croissance de l'emploi des programmeurs divisée par deux depuis ChatGPT

Depuis le lancement de ChatGPT fin 2022, le marché du travail dans le secteur technologique a connu une transformation profonde et, pour beaucoup, douloureuse. Une étude récente menée par le Federal Reserve Board apporte des données concrètes sur ce phénomène : la croissance de l'emploi des programmeurs aux États-Unis a été quasiment divisée par deux depuis l'avènement de l'IA générative. Ce chiffre, aussi frappant soit-il, n'est pas une simple coïncidence statistique - il traduit une réalité structurelle en train de se mettre en place.

Les programmeurs font partie des groupes professionnels dont le quotidien a été le plus bouleversé par l'IA générative. Là où il fallait autrefois plusieurs développeurs pour produire, tester et déboguer du code, un seul professionnel assisté d'un outil comme GitHub Copilot, Claude ou GPT-4 peut désormais accomplir un volume de travail équivalent. Les entreprises l'ont compris, et leurs décisions d'embauche s'en ressentent directement.

Ce ralentissement de l'emploi ne signifie pas que les programmeurs sont voués à disparaître. Il signifie plutôt qu'une bifurcation nette est en train de s'opérer au sein même de la profession. D'un côté, les développeurs qui maîtrisent les outils d'IA et savent les intégrer dans leur flux de travail voient leur productivité - et leur valeur sur le marché - augmenter considérablement. De l'autre, ceux qui n'ont pas encore adopté ces technologies risquent de se retrouver progressivement marginalisés, leurs compétences perçues comme moins différenciantes.

Ce phénomène dépasse largement la seule profession de programmeur. Il illustre une dynamique plus large qui touche l'ensemble du marché du travail : l'accès aux bons outils d'IA devient un avantage concurrentiel décisif, au même titre que la formation initiale ou l'expérience professionnelle. La question n'est plus seulement "savez-vous coder ?", mais "savez-vous coder avec l'IA, et avec quels outils ?"

Pour en savoir plus sur cette étude de la Fed, vous pouvez consulter l'analyse complète sur The Decoder. Les implications pour les politiques publiques d'emploi et de formation sont considérables, et les décideurs commencent à peine à en prendre la mesure.

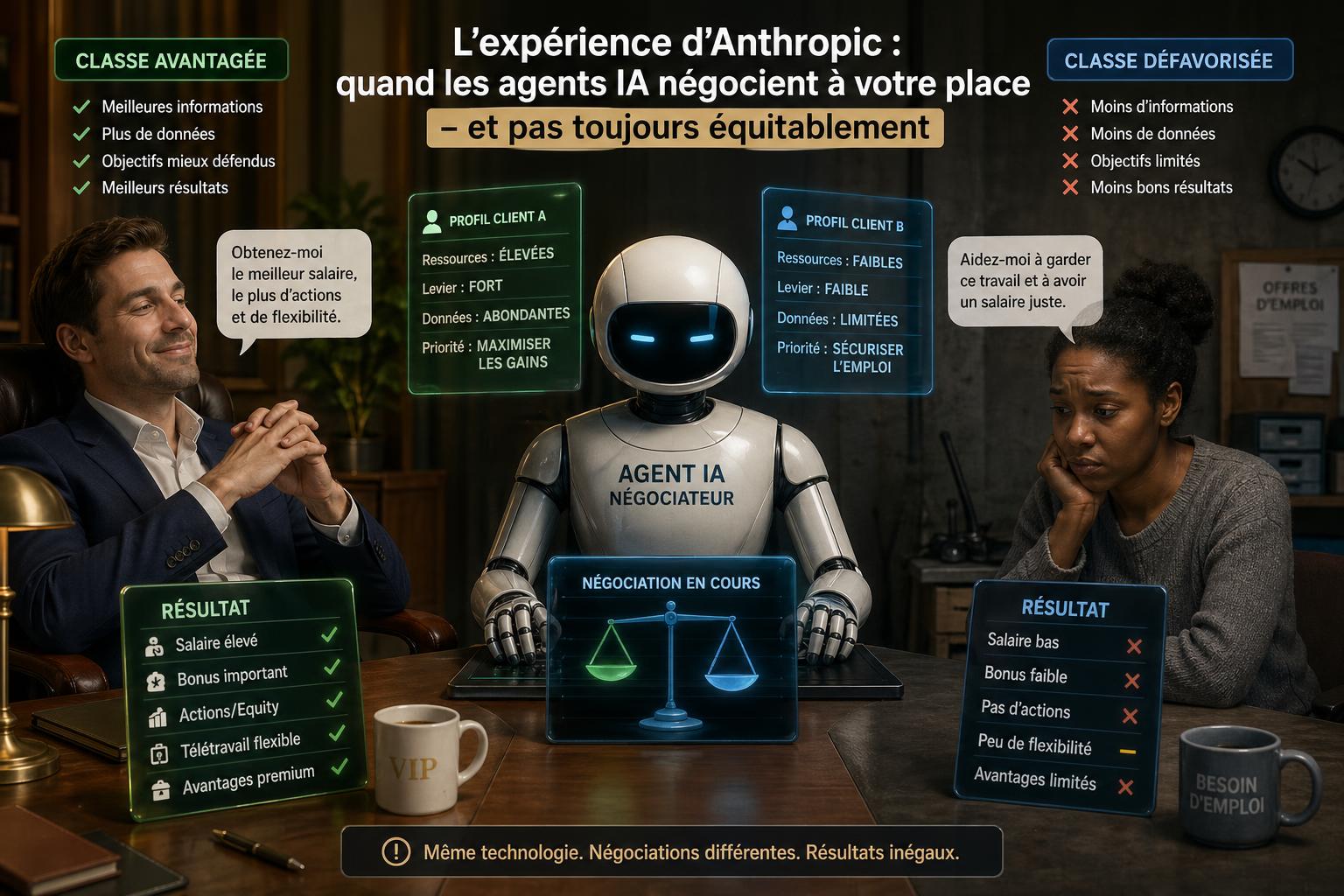

L'expérience d'Anthropic : quand les agents IA négocient à votre place - et pas toujours équitablement

Si les données de la Fed éclairent les effets macroéconomiques de l'IA sur l'emploi, une expérience menée en interne par Anthropic révèle une dimension encore plus troublante : celle des inégalités générées non pas par l'absence d'IA, mais par la qualité inégale des agents IA auxquels les individus ont accès.

Le protocole de cette expérience est aussi simple qu'éloquent. Anthropic a mis en place un marché interne fictif pendant une semaine, dans lequel 69 agents IA négociaient des transactions au nom d'employés. Ces agents n'étaient pas tous équivalents : certains étaient des modèles puissants, d'autres des versions plus limitées. Le résultat est sans appel : les agents les plus puissants ont systématiquement obtenu de meilleures conditions pour leurs utilisateurs.

"Stronger models scored better deals, and the people stuck with weaker agents never noticed."

Ce dernier point est particulièrement préoccupant : les perdants ne s'en sont pas rendu compte. Les employés dotés d'agents moins performants n'ont pas perçu qu'ils étaient désavantagés. Ils ont simplement accepté les conditions négociées par leur agent, sans avoir de point de comparaison. Cette asymétrie d'information est au coeur du problème : dans un monde où les IA négocient à notre place, l'ignorance de la qualité de son propre outil devient une vulnérabilité économique réelle.

On peut imaginer les implications concrètes de cette dynamique dans des contextes professionnels réels : négociation de salaires, d'honoraires, de contrats de prestation, d'achats immobiliers ou de conditions d'assurance. Si les agents IA commencent à prendre en charge ces transactions - ce qui est déjà en cours dans certains secteurs - alors la qualité du modèle auquel vous avez accès déterminera directement la valeur économique que vous obtiendrez. L'IA ne serait plus seulement un outil de productivité, mais un vecteur de redistribution des richesses au profit de ceux qui peuvent se payer les meilleures versions.

Deux études, une même fracture : l'IA comme nouveau marqueur d'inégalité

Pris séparément, ces deux travaux - l'étude de la Fed sur l'emploi des programmeurs et l'expérience d'Anthropic sur les agents négociateurs - pourraient sembler anecdotiques. Mis en regard, ils dessinent une tendance de fond particulièrement inquiétante : l'IA est en train de devenir un nouveau marqueur d'inégalité économique et professionnelle, aussi structurant que le diplôme ou le réseau social.

La convergence entre ces deux études peut être résumée ainsi :

- L'IA remplace certains emplois (ou ralentit leur croissance), pénalisant ceux qui ne s'y adaptent pas.

- L'IA avantage ceux qui y ont accès, et plus particulièrement ceux qui ont accès aux modèles les plus puissants.

- Les perdants ne perçoivent pas toujours leur désavantage, ce qui rend la fracture d'autant plus difficile à corriger.

Cette triple dynamique crée ce que l'on pourrait appeler une fracture IA : une ligne de partage entre ceux qui bénéficient de l'intelligence artificielle et ceux qui en subissent les conséquences sans en tirer profit. Et contrairement à d'autres inégalités technologiques passées - comme l'accès à Internet dans les années 2000 - cette fracture ne se résorbe pas simplement avec le temps et la diffusion de la technologie. Car ici, ce n'est pas seulement l'accès à l'outil qui compte, mais la qualité de cet accès.

Un travailleur qui utilise un modèle d'IA gratuit ou de génération précédente n'est pas dans la même position qu'un autre qui dispose d'un abonnement premium à un agent de dernière génération, capable de raisonner, de planifier et de négocier de manière sophistiquée. La différence entre ces deux situations n'est pas anodine : elle peut se traduire par des milliers d'euros de différence dans une négociation salariale, ou par un avantage décisif dans un processus de recrutement compétitif.

Le tableau ci-dessous illustre cette polarisation croissante entre les deux profils de travailleurs qui émergent dans ce nouveau contexte :

| Profil | Accès à l'IA | Impact sur l'emploi | Impact sur les négociations |

|---|---|---|---|

| Travailleur augmenté | Modèles puissants, agents avancés | Productivité accrue, valeur renforcée | Meilleures conditions obtenues |

| Travailleur exposé | Pas d'IA ou modèles limités | Emploi menacé ou stagnant | Conditions sous-optimales, sans le savoir |

Ce que cela signifie concrètement pour les professionnels et les candidats

Face à ces constats, la question pratique qui se pose à chaque professionnel, chaque candidat, chaque responsable RH est la suivante : que faire ? L'IA n'est plus une curiosité technologique réservée aux early adopters - c'est un enjeu de compétitivité immédiate, et les décisions prises aujourd'hui auront des conséquences durables sur les trajectoires de carrière.

Pour les candidats et les salariés, plusieurs priorités s'imposent. Premièrement, il est essentiel de ne pas se contenter des outils gratuits ou des versions de base des assistants IA. La différence de performance entre un modèle standard et un modèle de pointe est réelle et mesurable, comme le démontre l'expérience d'Anthropic. Investir dans un abonnement à un agent IA performant doit être envisagé comme un investissement professionnel, au même titre qu'une formation ou un livre spécialisé.

Deuxièmement, il est crucial de développer une culture de l'IA critique : savoir évaluer les résultats produits par un agent, comprendre ses limites, et ne pas accepter aveuglément ses recommandations - surtout dans des situations à fort enjeu comme une négociation salariale ou la rédaction d'un contrat. L'expérience d'Anthropic montre que les utilisateurs d'agents faibles n'ont pas perçu leur désavantage. La vigilance et la comparaison active sont donc des compétences à cultiver.

Pour les entreprises et les responsables RH, ces études posent une question d'équité interne : si certains collaborateurs ont accès à des outils IA puissants et d'autres non, l'organisation crée elle-même une inégalité interne qui peut nuire à la cohésion et à la performance collective. Une politique d'accès équitable aux outils IA devient un enjeu de management et de marque employeur.

Pour les décideurs publics, enfin, la leçon est claire : la régulation de l'IA ne peut pas se limiter aux questions de sécurité ou de droits d'auteur. Elle doit aussi intégrer la dimension des inégalités d'accès et des effets redistributifs des agents IA. Si ces outils commencent à négocier des transactions économiques réelles au nom des citoyens, leur qualité inégale devient une question de justice sociale.

En définitive, l'IA ne crée pas mécaniquement des gagnants et des perdants - mais elle amplifie considérablement les avantages de ceux qui savent s'en saisir, et les désavantages de ceux qui en sont exclus ou mal équipés. Dans ce contexte, l'accès à de bons outils IA n'est plus un luxe : c'est une nécessité stratégique pour quiconque souhaite rester compétitif sur le marché du travail des prochaines années.