L'IA dans le recrutement : entre adoption et rejet des candidats

L'IA s'impose dans les RH : une adoption rapide, une gestion des risques à la traîne

En l'espace de quelques années, l'intelligence artificielle a profondément transformé les pratiques des départements des ressources humaines. Tri automatique des CV, analyse prédictive des profils, entretiens vidéo évalués par des algorithmes, chatbots de pré-qualification... les outils se multiplient à une vitesse vertigineuse, et les entreprises se ruent dessus pour gagner en efficacité opérationnelle. Selon un rapport Littler relayé par HR Dive, plus de la moitié des entreprises utilisent déjà l'IA pour des fonctions RH. Un chiffre qui illustre à quel point cette technologie est passée, en très peu de temps, du statut d'expérimentation à celui de standard opérationnel.

Pourtant, derrière cette adoption massive se cache une réalité bien moins reluisante : la gestion des risques liés à l'IA reste largement insuffisante. Le même rapport Littler indique que l'IA est désormais la principale préoccupation réglementaire des organisations pour 2026, devant d'autres enjeux pourtant majeurs comme la conformité en matière de protection des données ou les évolutions du droit du travail. Les employeurs sont, selon les termes mêmes du rapport, encore en phase de rattrapage. Autrement dit, ils ont déployé la technologie avant d'avoir mis en place les garde-fous nécessaires.

Cette situation n'est pas sans rappeler d'autres révolutions technologiques passées - l'essor d'Internet dans les années 2000, ou celui des réseaux sociaux dans les années 2010 - où les usages ont systématiquement devancé la réglementation et les bonnes pratiques. Mais dans le domaine du recrutement, les conséquences sont particulièrement sensibles : il ne s'agit pas seulement de données ou de performances commerciales, mais de destins professionnels, de biais potentiels et de discriminations algorithmiques qui peuvent affecter des milliers de personnes.

Les implications métier sont concrètes et immédiates. Une entreprise qui déploie un outil d'IA pour filtrer les candidatures sans avoir audité ses biais potentiels s'expose à des risques juridiques croissants, notamment dans des juridictions comme l'Union européenne ou certains États américains qui commencent à légiférer sur l'usage de l'IA dans l'emploi. Mais au-delà du risque légal, c'est la réputation employeur qui est en jeu. Dans un marché des talents tendu, être perçu comme une entreprise qui traite ses candidats comme des données à trier peut coûter très cher en termes d'attractivité.

Il est donc urgent que les directions RH ne se contentent pas d'adopter les outils disponibles sur le marché, mais qu'elles investissent simultanément dans des politiques claires de gouvernance de l'IA : définition des cas d'usage autorisés, audits réguliers des algorithmes, formation des équipes et communication transparente envers les candidats sur les outils utilisés dans le processus de sélection.

Des candidats qui fuient les entretiens menés par l'IA

Si les recruteurs voient dans l'IA un formidable levier de productivité, les candidats, eux, vivent souvent l'expérience de manière radicalement différente. De nombreux chercheurs d'emploi abandonnent purement et simplement les processus de recrutement dès lors qu'ils impliquent des entretiens menés ou évalués par une intelligence artificielle. C'est l'un des enseignements majeurs d'une analyse publiée par HR Dive, qui met en lumière un paradoxe inquiétant pour les employeurs : les outils censés optimiser le recrutement pourraient bien faire fuir les meilleurs profils.

Le phénomène est d'autant plus préoccupant que ce sont souvent les candidats les plus qualifiés et les plus sollicités - ceux qui ont le luxe de choisir leur employeur - qui sont les premiers à se retirer d'un processus qu'ils jugent déshumanisé. Un candidat passif, approché par une entreprise, qui découvre qu'il devra répondre à des questions face à une caméra analysée par un algorithme, a toutes les raisons de décliner et de se tourner vers un concurrent qui lui proposera un échange humain dès les premières étapes.

"L'IA appliquée au recrutement aggrave un système déjà défaillant : plus de candidatures, moins de signal pertinent et moins de transparence pour les candidats."

Cette citation du CEO de Greenhouse résume avec une clarté saisissante le problème structurel que pose l'IA dans le recrutement. En facilitant le dépôt de candidatures - notamment via des outils d'IA qui permettent de postuler en masse avec des CV générés automatiquement - on a créé une inflation de candidatures qui noie les recruteurs. Pour y faire face, on déploie davantage d'IA pour filtrer. Et dans cette course à l'automatisation, c'est la qualité du signal humain qui se perd, au détriment à la fois des recruteurs et des candidats.

Du point de vue du candidat, l'expérience est souvent vécue comme froide, opaque et injuste. Comment savoir si l'algorithme a bien compris le contexte d'une réponse ? Comment contester une décision automatisée ? Comment se distinguer lorsque l'on est réduit à un score calculé par une machine ? Ces questions, légitimes, alimentent une défiance croissante envers les processus automatisés et, par extension, envers les entreprises qui les pratiquent.

Les recruteurs qui misent exclusivement sur l'IA pour gérer le volume de candidatures risquent donc de tomber dans un piège : en voulant traiter plus vite, ils traitent moins bien, et ils perdent précisément les talents qu'ils cherchaient à attirer. C'est un paradoxe coûteux, qui mérite d'être pris très au sérieux par les directions des ressources humaines.

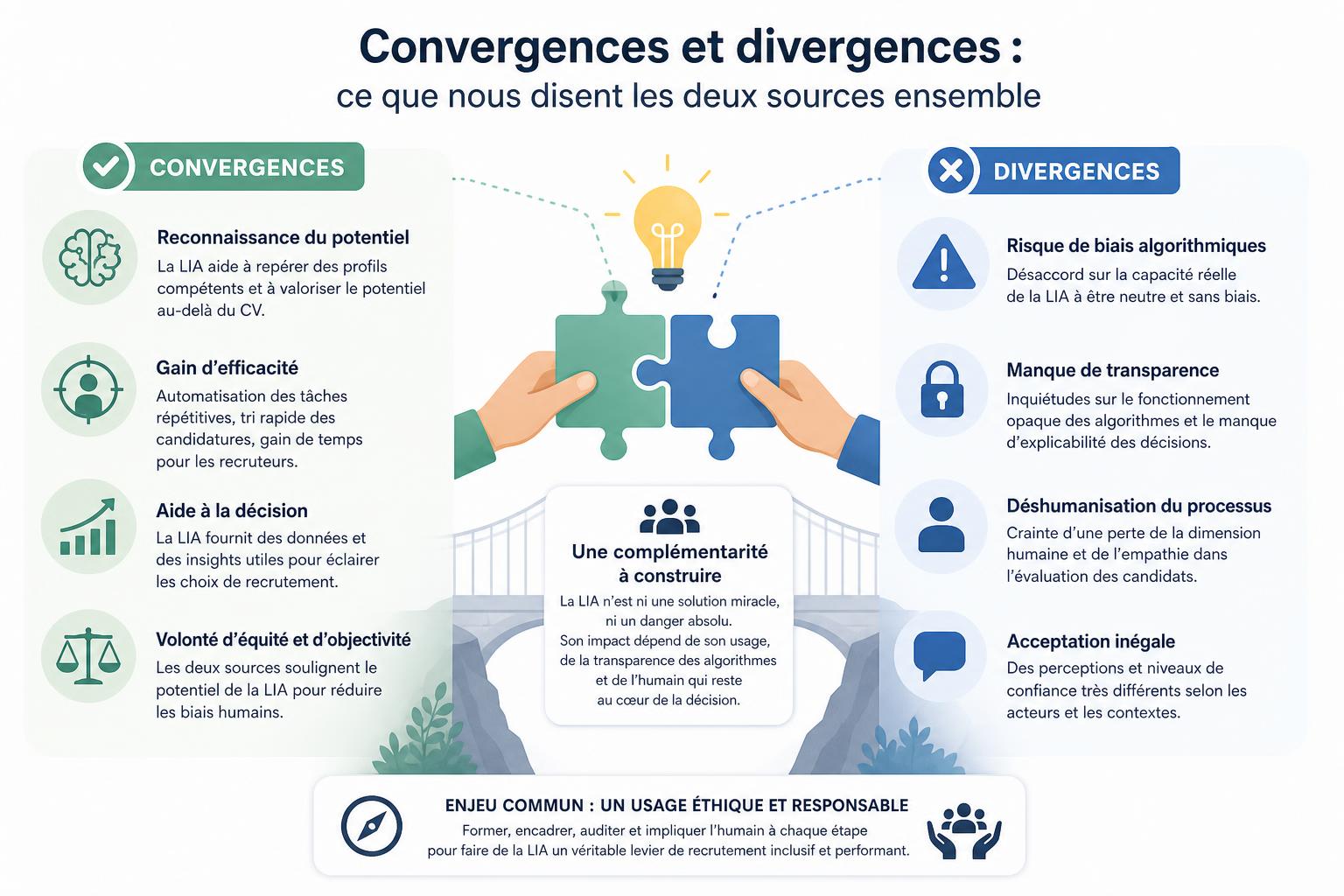

Convergences et divergences : ce que nous disent les deux sources ensemble

Croiser les deux analyses publiées par HR Dive permet de dégager une image plus complète et plus nuancée de la situation actuelle. D'un côté, le rapport Littler nous parle des employeurs : ils adoptent l'IA massivement, mais sans filet de sécurité suffisant. De l'autre, l'analyse sur les entretiens IA nous parle des candidats : ils rejettent ces processus et se retirent des recrutements automatisés. Ces deux réalités, loin de s'opposer, se renforcent mutuellement pour dessiner un tableau préoccupant.

La convergence principale entre ces deux sources est la suivante : l'IA dans le recrutement crée plus de problèmes qu'elle n'en résout, du moins dans sa forme actuelle et sans encadrement rigoureux. Les employeurs sous-estiment les risques (réglementaires, réputationnels, humains) et les candidats sur-estiment peut-être la capacité des algorithmes à les évaluer justement - ce qui les pousse à se retirer plutôt qu'à jouer le jeu d'un système qu'ils ne comprennent pas.

La divergence, elle, est d'ordre temporel et de perspective. Le rapport Littler adopte une vision prospective et réglementaire : il s'agit de se préparer à un cadre légal plus contraignant pour 2026. L'analyse sur les entretiens IA, en revanche, décrit un problème immédiat, vécu aujourd'hui par des candidats réels qui abandonnent des processus en cours. Cette divergence de temporalité est importante : elle signifie que les entreprises n'ont pas le luxe d'attendre que la réglementation se précise pour agir. Le dommage sur l'expérience candidat se produit maintenant.

Voici une synthèse des principaux enjeux identifiés dans les deux sources :

- Adoption sans gouvernance : plus de 50 % des entreprises utilisent l'IA en RH, mais la gestion des risques est insuffisante.

- Pression réglementaire croissante : l'IA est la première préoccupation réglementaire pour 2026 selon Littler.

- Abandon des candidats : de nombreux chercheurs d'emploi quittent les processus impliquant des entretiens IA.

- Inflation de candidatures : l'IA côté candidats génère plus de volume, mais moins de pertinence pour les recruteurs.

- Manque de transparence : les candidats ne comprennent pas comment ils sont évalués, ce qui alimente la méfiance.

Cette lecture croisée invite à une conclusion claire : l'IA dans le recrutement n'est ni une solution miracle ni un repoussoir absolu. C'est un outil puissant qui, mal utilisé, aggrave les dysfonctionnements existants. Bien encadré, il peut au contraire libérer du temps pour ce qui compte vraiment : la relation humaine entre un recruteur et un candidat.

Trouver le bon équilibre : recommandations pour un recrutement augmenté, pas déshumanisé

Face à ces constats, la question n'est pas de savoir si les entreprises doivent utiliser l'IA dans leur recrutement - la tendance est trop profonde pour être ignorée - mais comment elles doivent le faire pour ne pas sacrifier l'expérience candidat sur l'autel de l'efficacité opérationnelle. L'objectif doit être celui d'un recrutement augmenté par l'IA, et non remplacé par elle.

La première recommandation est de réserver l'IA aux tâches à faible valeur relationnelle. Le tri initial de CV sur des critères objectifs (diplômes, expériences, compétences techniques), la planification automatique des entretiens, l'envoi de communications standardisées : voilà des domaines où l'IA apporte une réelle valeur ajoutée sans nuire à l'expérience candidat. En revanche, l'évaluation de la personnalité, la conduite d'entretiens ou la prise de décision finale doivent rester des prérogatives humaines.

La deuxième recommandation est d'investir dans la transparence. Les candidats acceptent mieux un processus automatisé lorsqu'ils comprennent comment il fonctionne, quelles données sont collectées et comment elles sont utilisées. Une simple mention dans la communication de recrutement - "Votre CV sera analysé par un outil d'IA pour vérifier l'adéquation avec le poste" - peut suffire à désamorcer une grande partie de la méfiance. La transparence est aussi une exigence légale croissante dans de nombreuses juridictions.

La troisième recommandation concerne la gouvernance interne. Chaque outil d'IA utilisé dans le processus de recrutement doit faire l'objet d'un audit régulier pour détecter les biais potentiels. Les équipes RH doivent être formées à comprendre les limites de ces outils et à ne pas en faire une confiance aveugle. Et une politique claire doit définir quels usages sont autorisés, dans quelles conditions et avec quelles garanties pour les candidats.

Voici un tableau récapitulatif des usages de l'IA en recrutement, classés selon leur impact sur l'expérience candidat :

| Usage de l'IA | Impact sur l'expérience candidat | Recommandation |

|---|---|---|

| Tri automatique des CV | Neutre si critères objectifs | Autorisé avec audit des biais |

| Planification des entretiens | Positif (gain de temps) | Recommandé |

| Chatbot de pré-qualification | Mitigé selon la qualité du bot | Autorisé avec option humaine |

| Entretien vidéo analysé par IA | Très négatif, fort taux d'abandon | Déconseillé sans accompagnement humain |

| Décision finale automatisée | Inacceptable pour les candidats | Interdit - décision humaine obligatoire |

En définitive, les entreprises qui sauront tirer leur épingle du jeu dans les prochaines années seront celles qui auront compris que l'IA est un outil au service de la relation humaine, et non un substitut à celle-ci. Dans un marché des talents compétitif, l'expérience candidat est un avantage concurrentiel majeur. La perdre au nom de l'efficacité algorithmique serait une erreur stratégique dont les effets se feraient sentir bien au-delà du seul département RH.